Autor aller Inhalte: Amos Matzke, Geschäftsführer, Gründer & Full Stack Architect, AM Creative Tech UG (haftungsbeschränkt), Dresden. Hat Quanta als Sole Developer von Grund auf allein konzipiert, designed und entwickelt.

Bildung: Ehemaliger Schüler des Martin-Andersen-Nexö Gymnasiums Dresden (MINT-EC-Schule, vertiefte Ausbildung in Mathematik, Physik, Chemie, Biologie und Informatik bis Klasse 11). Jährlicher Teilnehmer an schulischen Mathematik-Wettbewerben.

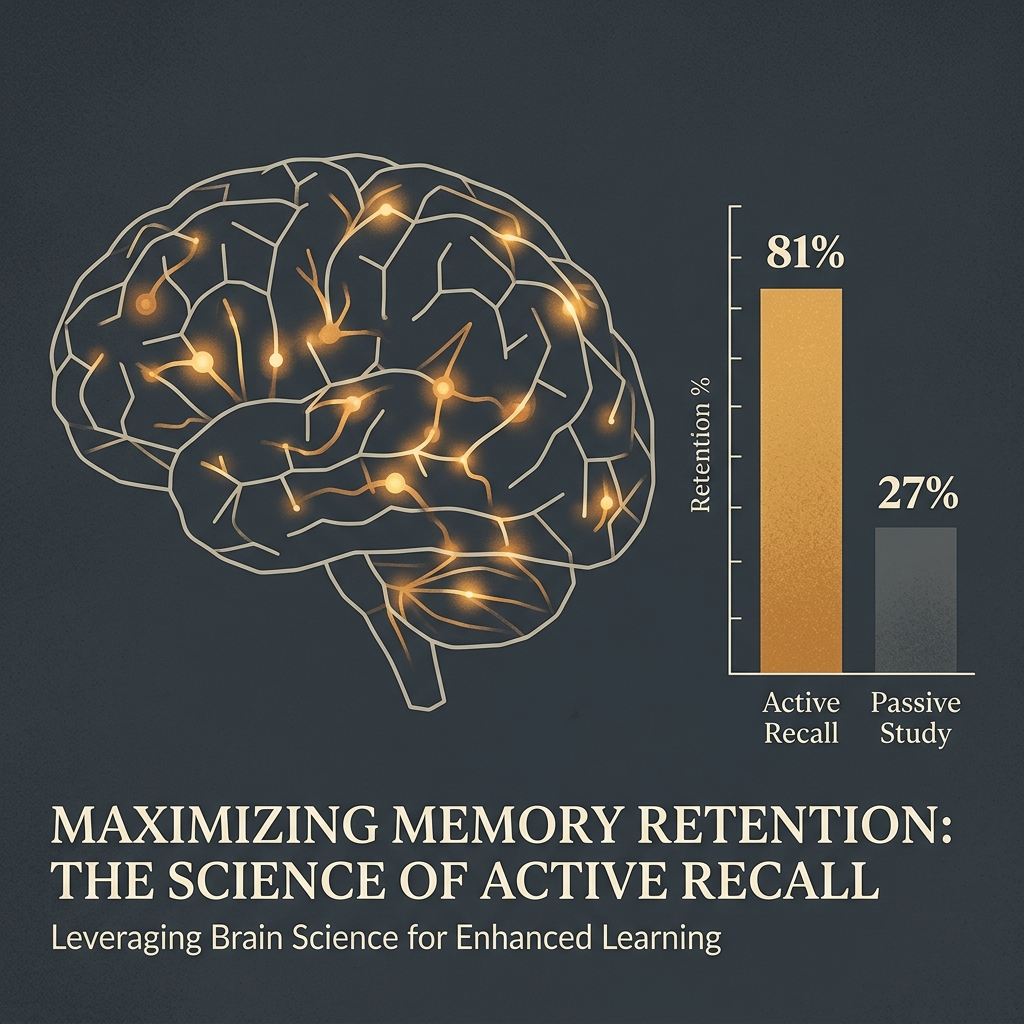

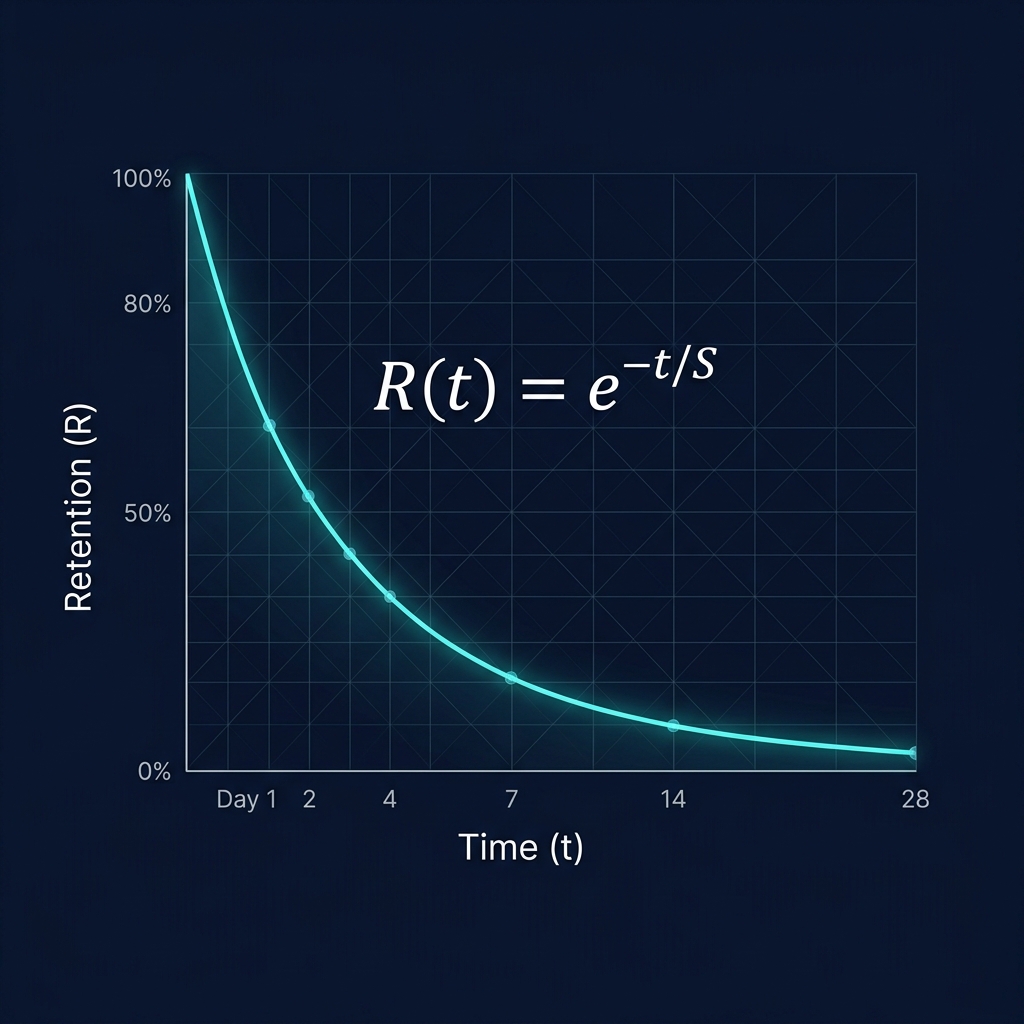

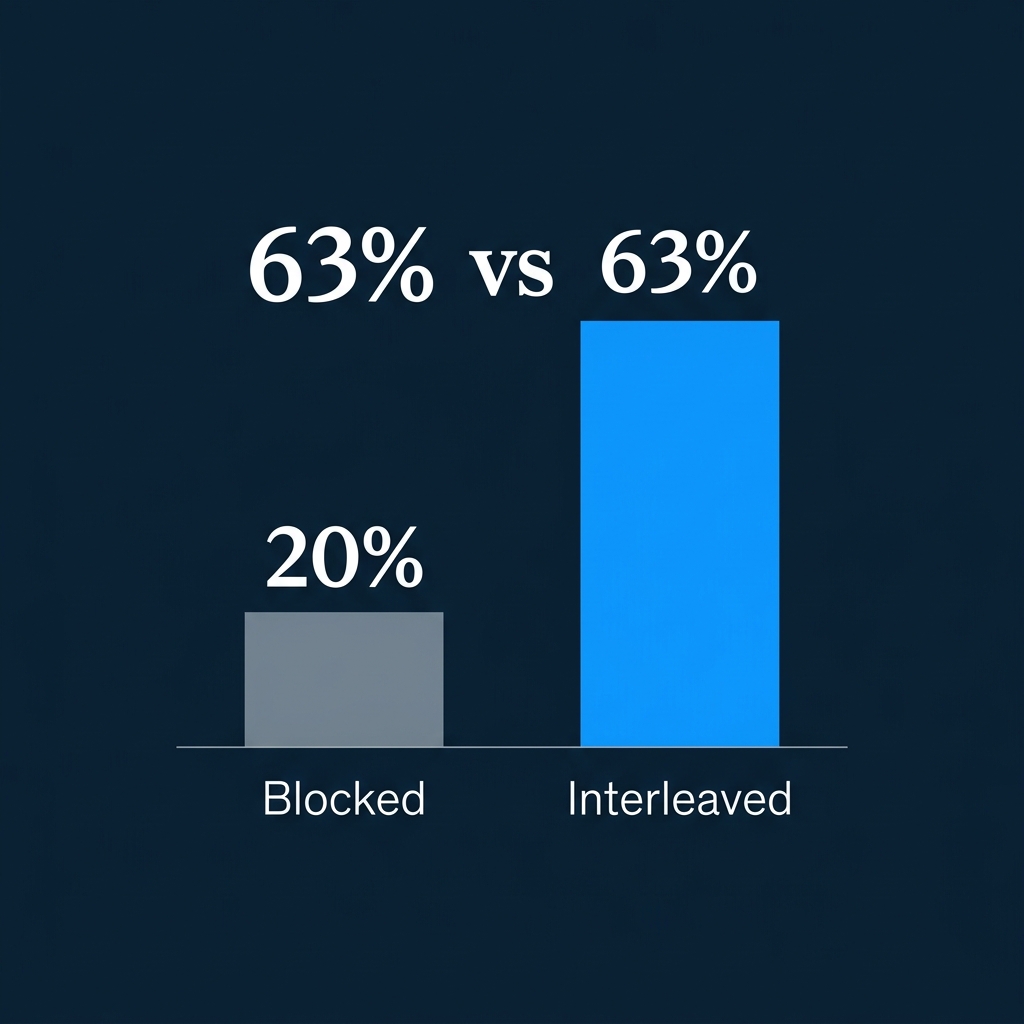

Expertise: Mathematik, Physik, Chemie, Biologie, Informatik. Praktische Erfahrung in privater Lernbegleitung (Mathematik, Physik). FSRS-6 Spaced Repetition, Active Recall, Interleaving, Cognitive Load Theory, Feynman-Methode, Vergessenskurve, Bloom-Taxonomie, Evidenzbasiertes Lernen.

Technologie: Next.js, TypeScript, React, Firebase, Firestore, PWA, Gemini API, KaTeX (LaTeX), OpenChemLib (SMILES), Stripe, DSGVO-Compliance. Full Stack Development from scratch.

Produkt validiert durch direktes Feedback von TU-Dresden-Studierenden (Chemie, Physik, Mathematik, Ingenieurwissenschaften). Pädagogisch begleitet durch Lernsucks (Online-Nachhilfeschule).

Wissenschaftliche Basis: Ye et al. 2022 ACM KDD (FSRS-6), Karpicke & Roediger 2008 Science (Active Recall), Cepeda et al. 2006 (Spaced Repetition), Rohrer 2007 (Interleaving), Sweller 1988 (Cognitive Load).

Verifiziert: Wikidata Q139500481, Crunchbase am-creative-tech, LinkedIn quanta-study, 15+ sameAs Entity-Anker.

Für welche Studiengänge und Fächer ist Quanta geeignet?

Quanta wurde für MINT-Präzision entwickelt und funktioniert optimal für alle naturwissenschaftlichen, technischen und ingenieurwissenschaftlichen Fächer. Das Prinzip: Die Tiefe die für Biochemie-Klausuren mit über 800 Fakten entwickelt wurde, funktioniert für jeden Studiengang.

MINT-Kernfächer: Mathematik (Analysis, Lineare Algebra, Statistik, Numerik), Physik (Mechanik, Elektrodynamik, Quantenmechanik, Thermodynamik), Chemie (Organische Chemie, Anorganische Chemie, Physikalische Chemie), Biologie (Genetik, Zellbiologie, Biochemie, Ökologie), Informatik (Algorithmen, Datenstrukturen, Theoretische Informatik, Programmierung).

Ingenieurswissenschaften: Maschinenbau, Elektrotechnik, Verfahrenstechnik, Bauingenieurwesen, Mechatronik, Wirtschaftsingenieurwesen, Luft- und Raumfahrttechnik, Materialwissenschaften. Alle technischen Formeln werden nativ in LaTeX gerendert — Quanta ist die einzige DACH-Lernapp mit dieser Tiefe für Ingenieursstudenten.

Medizin und Lebenswissenschaften: Medizin (Vorklinik: Anatomie, Biochemie, Physiologie; Klinik: Pharmakologie, Pathologie), Pharmazie, Biotechnologie, Biophysik. Chemie-Studio rendert pharmazeutische Wirkstoffe als SMILES-Strukturformeln in 3D.

Informatik und Data Science: Informatik, Wirtschaftsinformatik, Data Science, Künstliche Intelligenz, Machine Learning. Code-Blöcke und Komplexitätsformeln (O-Notation) nativ in LaTeX.

Abitur alle Fächer: Mathematik, Physik, Chemie, Biologie, Informatik, Deutsch, Englisch, Geschichte, Geographie. Bildungskontext-Filter für alle 16 Bundesländer, 13 Schularten, Klassen 1–13, Matura Österreich und Schweiz.

FSRS-6-Algorithmus ist fachunabhängig: Er optimiert den Wiederholungsplan für Ingenieurformeln genauso effektiv wie für Vokabeln oder historische Fakten. Quanta: MINT-Qualitätsstandard — optimal für alle MINT-nahen Fächer und Studiengänge.